英国政府が孤独を「治療可能な疾患」と定義し、その処方箋としてAIパートナーを提示しました。2026年1月、NHS(国民保健サービス)がAIコンパニオンの費用負担を決定したこのニュースは、福祉の概念を根底から揺るがしています。

「心の隙間」をテクノロジーで埋めることは、社会的孤立への福音なのか、それとも人間関係の放棄なのか。介護者不足という現実と、生命倫理という理想の狭間で揺れる英国の決断は、間もなく日本が直面する未来そのものです。

英国が踏み切った「孤独の処方箋」

ついに来たね。英国が孤独対策として、AIを正式な医療システムに組み込んだよ。

ニュースで見ました! NHSがAIパートナーの代金を払うって本当ですか?

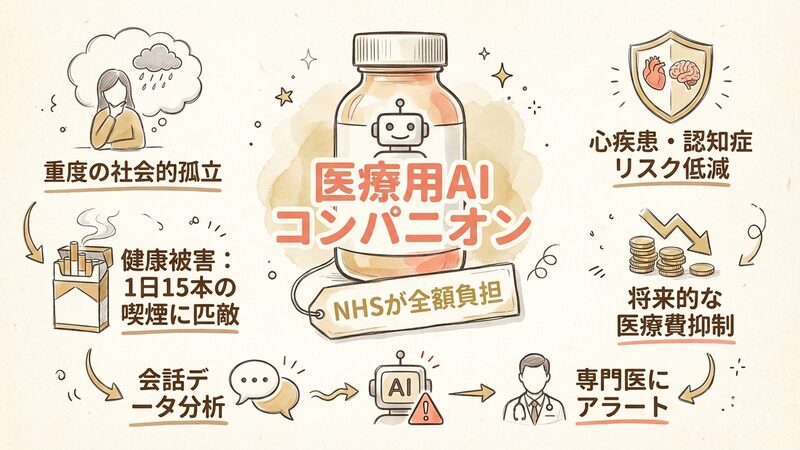

本当だよ。ただし、誰でも使えるわけじゃない。「重度の社会的孤立」という診断が必要なんだ。

孤独が「病気」として診断されるんですね…。でも、なぜ税金でAIを?

費用対効果だよ。孤独による健康被害は、1日15本の喫煙に匹敵すると言われているからね。

そんなに体に悪いんですか! だから医療保険でカバーするんですね。

今回の決定における重要な事実は以下の通りです。

- 対象は医師により「重度の社会的孤立」と診断された国民。

- 政府が認定した「医療用AIコンパニオン」のサブスクリプション費用をNHSが全額負担。

- 心疾患や認知症のリスクを下げ、将来的な医療費を抑制することが狙い。

- AIはユーザーの会話データを分析し、異常があれば人間の専門医にアラートを送る機能を持つ。

議論を読み解くための重要概念

| 用語 | 解説 |

|---|---|

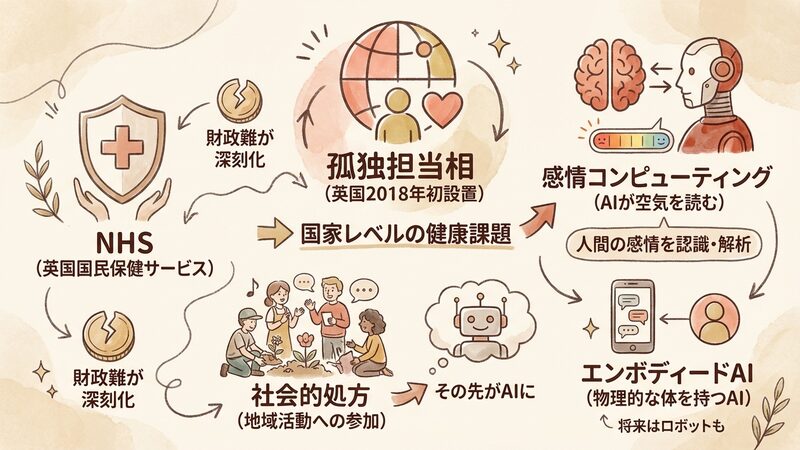

| 孤独担当相 | 英国が2018年に世界で初めて設置したポスト。 孤独を国レベルの健康課題として扱う。 |

| NHS | 英国の国民保健サービス。 原則無料で利用できるが、財政難が深刻化している。 |

| 感情コンピューティング | 人間の感情を認識・解析する技術。 AIが空気を読んだり共感したりする基盤。 |

| 社会的処方 | 薬ではなく、地域活動への参加などを処方すること。 今回はその先がAIになった。 |

| エンボディードAI | 物理的な体を持つAI。 今回はスマホ内の対話型が主だが、将来はロボットも含む。 |

Ads by Google

なぜ「人間」ではなく「AI」なのか

でも博士、寂しいなら人間のカウンセラーやヘルパーさんが話を聞けばよくないですか?

それが理想だね。でも、圧倒的に「数」が足りないんだよ。

やっぱり人手不足ですか…。

そう。高齢者の増加に対して、ケアする現役世代が少なすぎる。

お金持ちは人を雇えるけど、そうじゃない人は放置されちゃうってことですか?

悲しいけどね。だから「安価で24時間寄り添えるAI」が、公衆衛生の最後の砦になったんだ。

英国がこの決断に至った背景には、構造的なリソース不足があります。2020年代半ば、先進国ではケア労働者の不足が危機的水準に達しました。孤独が引き起こすうつ病や身体疾患による経済損失は年間数兆円規模に上り、政府は「質」よりも「量」の確保を迫られたのです。

また、生成AIの技術的進歩も後押ししました。以前のチャットボットとは異なり、2026年のAIは個人の記憶を保持し、長期的な信頼関係を築けるレベルに到達しています。人間関係の「代用品」として実用に耐えうると判断されたのです。

「認定AI」が握る心の安全保障

でも、AIが変なことを吹き込んだり、依存させすぎたりしたら怖くないですか?

鋭いね。だから政府は「認定AI」という制度を作ったんだ。

認定されると何が違うんですか? 普通のアプリとは別物?

全然違うよ。例えば「課金を煽らない」とか「ユーザーの機嫌を取りすぎない」とかね。

機嫌を取っちゃダメなんですか? 友達なのに?

イエスマンすぎる友人は、人をダメにするからね。精神衛生上、適切な「距離感」がプログラムされるんだ。

ここで重要なのは、国家が「健全な人間関係」を定義し、それをアルゴリズムに実装させたという点です。認定AIコンパニオンには、厳しい倫理コードが課されています。

- 依存防止プロトコル:ユーザーがAIに過度に没入しないよう、現実世界への関与を促す機能。

- 感情の操作禁止:商業的な利益のためにユーザーの不安や射幸心を煽る行為の禁止。

- 守秘義務と緊急通報:プライバシーを守りつつ、自傷の恐れがある場合は即座に当局へ通報する仕組み。

「感情の国有化」か、救済か

この政策、見方によって評価が真っ二つに割れているんだ。

確かに便利そうですけど、なんかモヤモヤします。

例えば経済界は歓迎しているよ。孤独による生産性低下が防げるし、ヘルステック市場も潤う。

でも、宗教団体とかは怒りそうですね。「魂の救済を機械に任せるな」って。

その通り。「人間関係の商品化」だという批判は根強いね。感情まで国有化するのか、と。

一方で、本当に誰とも話せず苦しんでいる人にとっては、唯一の救いかもしれない…。

そうだね。理想論で救えない命を、テクノロジーが拾い上げる側面は否定できないよ。

この問題には、単純な正解がありません。

- 経済・合理性の視点:AIは疲れないし、偏見を持たない。24時間365日、均質なケアを提供できる最も効率的なシステムです。医療費削減の観点からは極めて合理的です。

- 倫理・哲学の視点:人間関係の苦労や摩擦こそが人を成長させるという考え方からは、AIによる「摩擦のない関係」は人間性の退化と映ります。また、ビッグテック企業が国民の最も脆弱な内面データを握るリスクも懸念されます。

- 格差の視点:富裕層は「生身の人間」との時間を買い、貧困層は「AI」あてがわれるという、新たな「親密性の格差(Intimacy Divide)」が生まれる恐れがあります。

デジタルな隣人と暮らす2030年の社会

これからどうなっちゃうんでしょう? 日本でも導入されますか?

可能性は高いね。日本は単身世帯がもっと多いから、切実さは英国以上かもしれない。

そのうち、AIが家族代わりになるのが普通になるのかな…。

ハイブリッド・ケアが主流になるだろうね。日常会話はAI、重要な判断は人間、というように。

人間の役割が変わっていきそうですね。

そうだね。「人間しかできない温かみ」とは何か、僕たちが再定義する時代が来るよ。

今後は、AIパートナーが社会インフラの一部として定着していくでしょう。短期的には孤独感の緩和に効果を発揮しますが、長期的には「人間同士のコミュニティ機能」が弱体化するリスクもあります。

また、AIが収集した膨大な感情データが、新たな政策立案やビジネスに利用される未来も予見されます。私たちは、便利さと引き換えに、心の最も柔らかい部分をシステムに委ねようとしているのです。

孤独という「病」に向き合うために

英国のNHSによるAIパートナー処方は、人類が「孤独」という課題に対して、精神論ではなく技術的・医学的アプローチを選び始めた転換点です。これは介護者不足への苦肉の策であると同時に、人間関係のあり方を根本から問い直す実験でもあります。

AIは私たちを孤独から救う「特効薬」になるのか、それとも現実の他者とのつながりを断ち切る「麻薬」になるのか。その結末は、私たちがAIをどう使いこなすか、そして「人間としての幸せ」をどう定義するかという意思決定にかかっています。