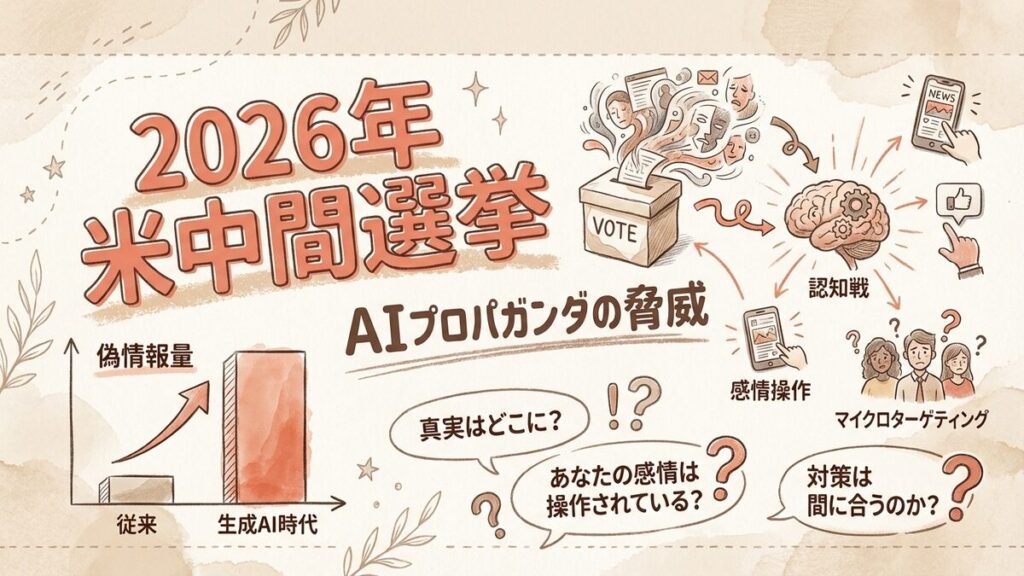

2026年1月、米国では11月の中間選挙に向けた予備選シーズンが幕を開けました。しかし、今回の選挙戦は過去のどの選挙とも異なる様相を呈しています。生成AI技術の爆発的な普及により、真偽不明の情報がかつてない規模と速度で拡散しているのです。

この記事の要約

- 2026年米中間選挙に向け、AIによる偽情報拡散が深刻化している

- 法規制が技術進化に追いつかず、認知操作のリスクが高まる

- 有権者は「情報の真偽」を見極める新たなリテラシーを求められる

本記事では、AI技術が選挙という民主主義の根幹にどのような影響を与えているのか、そのメカニズムと対策について、2026年の現在地点から深掘りします。

「真実」が消える? 史上最も混乱する選挙戦へ

いよいよ2026年の中間選挙シーズンだね。気付いたことはある?

ネットの広告や動画が、なんだかすごくリアルになった気がします。

鋭いね。今回の主役は候補者じゃない。生成AIなんだよ。

えっ、AIが主役? どういうことですか?

AIが作った「精巧な偽情報」が、大量に溢れているんだ。

それって、フェイクニュースのことですか? 前からありましたよね。

質と量が違うんだ。個人の感情を狙い撃ちにするから厄介だよ。

私の感情も狙われてるってこと…? 怖くなってきました。

2026年米中間選挙における主要な懸念事項

- 超個人的なプロパガンダ: 個人のSNS履歴や行動データをAIが解析し、その人が最も信じ込みやすく、あるいは怒りを感じやすいメッセージを自動生成して配信する。

- 法的空白地帯: AIによる選挙干渉を規制する連邦法の整備が難航しており、州ごとに規制がバラバラな状態で選挙戦に突入している。

- 検証の限界: ディープフェイク動画や音声の生成コストが極限まで下がり、ファクトチェック機関の処理能力を遥かに超える量の偽情報が流通している。

ニュースを読み解くためのキーワード

この問題を理解するために必要な専門用語を整理しましょう。

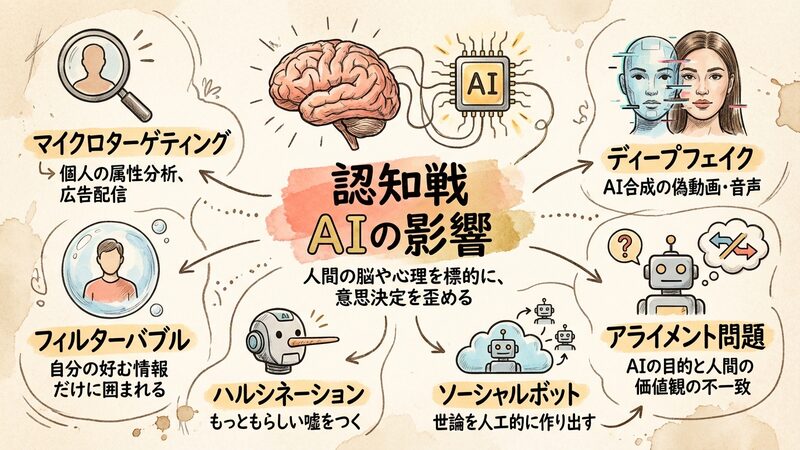

| 用語 | 解説 |

|---|---|

| マイクロターゲティング | 個人の属性や行動履歴を分析する手法。 特定の個人に響く広告を配信する。 |

| ディープフェイク | AIで合成された偽の動画や音声。 本物と区別がつかないほど精巧。 |

| 認知戦(Cognitive Warfare) | 人間の脳や心理を標的にする戦い。 情報操作で意思決定を歪める。 |

| アライメント問題 | AIの目的と人間の価値観の不一致。 意図せぬ有害な出力を生む原因。 |

| ソーシャルボット | SNSで自動投稿するプログラム。 世論を人工的に作り出すために使われる。 |

| ハルシネーション | AIがもっともらしい嘘をつく現象。 事実に基づかない情報を生成する。 |

| フィルターバブル | 自分の好む情報だけに囲まれる状態。 異なる意見が見えなくなる。 |

Ads by Google

2024年から何が変わったのか?

2年前の大統領選でも、AIは話題になっていましたよね?

そうだね。でも当時はまだ「実験段階」だったんだよ。

今はもう、実験じゃなくて「実戦」なんですか?

その通り。ツールが民主化され、誰でも使えるようになった。

誰でも? 専門家じゃなくても偽動画が作れるんですか?

スマホ1つで、数秒あればね。しかもコストはほぼゼロだ。

うわあ。それじゃあ、嘘の拡散を止められないですね。

そう。量的な飽和攻撃が、今回の最大の特徴なんだ。

2024年の選挙時は、生成AIはまだ新しい技術であり、その利用には一定のスキルやコストが必要でした。また、主要なプラットフォーム企業も自主規制に積極的でした。しかし2026年現在、オープンソースの高性能モデルが広く出回り、規制の網をかいくぐる地下ツールも一般化しています。

技術の進化は、単に画質が良くなっただけではありません。「文脈の理解」が進みました。AIは、どのような言葉を選べば特定のコミュニティが激昂するか、あるいは安心するかを学習しています。これにより、一見すると政治的な広告には見えない「日常会話」の中に、巧みにプロパガンダを紛れ込ませることが可能になりました。

あなたの「心」がハッキングされる

一番の問題は、情報の「真偽」じゃないんだ。

えっ? 嘘か本当かが大事なんじゃないんですか?

違うんだな。大事なのは「信じたくなるかどうか」なんだ。

信じたくなる…? 自分の考えに合う情報ってことですか?

正解。AIは君が何に怒り、何を望んでいるかを知っている。

だから、嘘だと分かっていても拡散しちゃうんですね。

そう。認知バイアスをAIが増幅装置のように刺激するんだ。

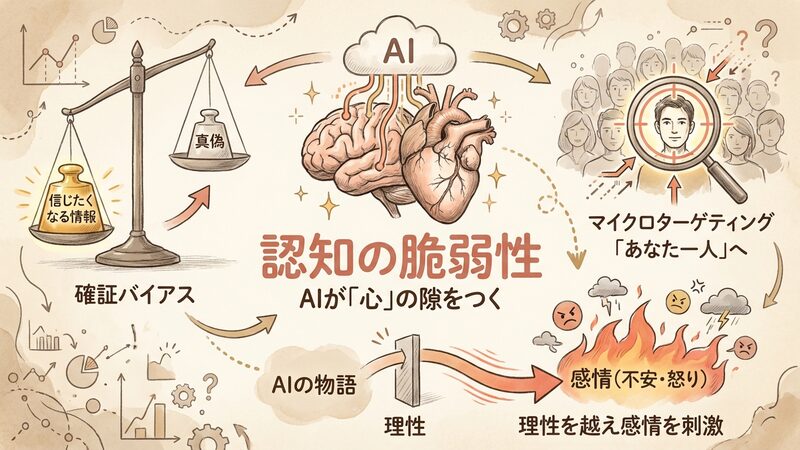

この問題の本質は、AIが私たちの「認知の脆弱性」を突いている点にあります。人間は、自分の既存の信念を補強する情報を好意的に受け入れ、反する情報を無意識に排除する傾向(確証バイアス)があります。

従来のプロパガンダは「大衆」に向けたものでしたが、AIによるマイクロターゲティングは「あなた一人」のためにカスタマイズされた物語を提供します。例えば、経済に不安を持つ人には「特定の政策があなたの貯金を奪う」という偽のニュースを、治安を懸念する人には「近所で犯罪が急増している」という合成動画を見せます。これらは個人の不安や怒りのスイッチを正確に押すため、理性を飛び越えて感情に直接作用するのです。

誰が「正義」を決めるのか?

そんなに危険なら、法律で厳しく禁止すべきじゃないですか?

そこが難しい。誰が「正しい情報」を決めると思う?

えっと…政府? それともAIを作った会社?

政府が決めると「検閲」になる恐れがあるよね。

確かに。時の権力者に都合の良い情報だけになりそうです。

じゃあ企業に任せる? 彼らは利益を追求する組織だよ。

うーん、どっちも信用しきれないかも…。

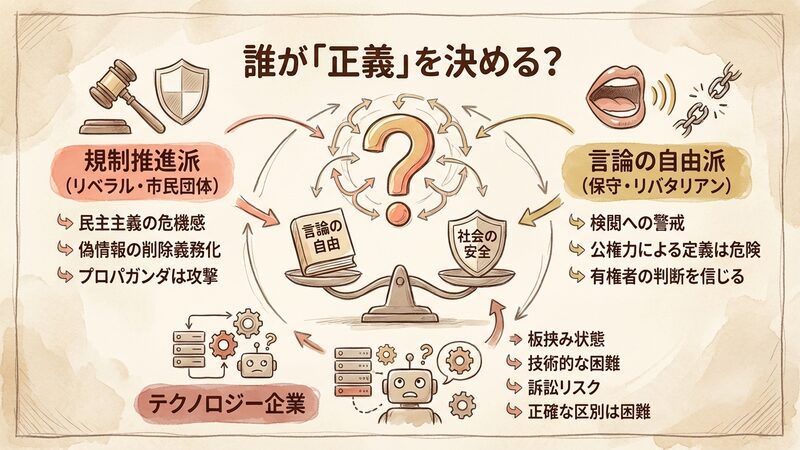

この問題には、立場の異なる複数の視点が存在し、単純な解決策を拒んでいます。

- 規制推進派(リベラル・市民団体)の視点:

民主主義を守るためには、プラットフォーマー(SNS運営企業など)に法的責任を負わせ、偽情報の削除を義務付けるべきだと主張します。彼らにとって、AIによるプロパガンダは「言論」ではなく「攻撃」であり、放置すれば社会が崩壊するという危機感があります。 - 言論の自由派(保守・リバタリアン)の視点:

政府や企業による情報の選別は、事実上の検閲につながると警戒します。「何が真実か」を公権力が定義すること自体が危険であり、有権者の判断能力を信じるべきだと主張します。過度な規制は、正当な政治的意見表明まで萎縮させると懸念しています。 - テクノロジー企業の視点:

彼らは板挟み状態です。厳しく規制すれば「偏向している」と批判され、放置すれば「無責任だ」と叩かれます。また、2026年現在、膨大な量のコンテンツをAIで自動監視していますが、皮肉、ジョーク、政治的風刺と、悪意ある偽情報を正確に区別することは技術的に困難であり、誤削除による訴訟リスクも抱えています。

民主主義は生き残れるか?

このままだと、誰も何も信じられない社会になりそうだね。

絶望的じゃないですか。何か希望はないんですか?

あるよ。「真正性(Authenticity)」を証明する技術だ。

本物であることを証明する、ってことですか?

そう。情報の「出所」をデジタル署名で保証するんだ。

なるほど! 嘘を見抜くより、本物を証明する方が確実ですね。

まさに。信頼の基盤を技術で再構築する試みだよ。

今後の展望として、2026年の中間選挙は「信頼性確認技術」の実験場となるでしょう。C2PA(Content Credentials)のような、コンテンツの来歴を証明する技術標準の導入が進んでいます。これにより、情報の発信元が確認できないコンテンツには「未検証」のラベルが付くようになります。

しかし、技術だけでは解決しません。長期的には、私たち一人ひとりの意識変革が必要です。情報を鵜呑みにせず、「なぜこの情報が今、私の目の前に現れたのか?」と問うAIリテラシーが、読み書きそろばんと同等の必須教養となるでしょう。2028年の大統領選挙に向け、この「認知の免疫力」を社会全体でどう高めていくかが、民主主義存続の鍵となります。

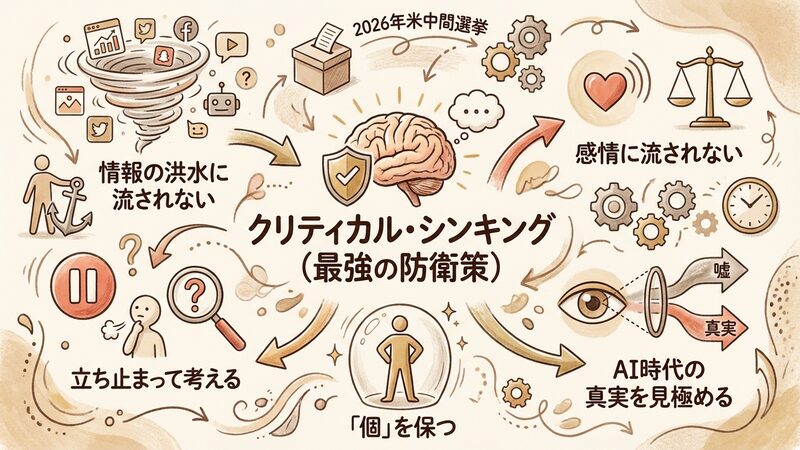

混沌の中で「個」を保つために

2026年の米中間選挙は、単なる議席争いを超え、私たちが「AI時代の真実」とどう向き合うかを問う歴史的な転換点となります。技術は進化し、嘘はより魅力的になりますが、最終的に情報を解釈し、判断するのは人間です。

情報の洪水に流されず、立ち止まって考えること。感情を揺さぶられた時こそ、一呼吸置くこと。この基本的なクリティカル・シンキングこそが、高度なAIプロパガンダに対する最強の防衛策となるでしょう。